Los modelos de inteligencia artificial generativa requieren cantidades masivas de memoria para funcionar, lo que ha convertido la RAM en un recurso costoso y difícil de adquirir. Google Research ha presentado TurboQuant, un innovador algoritmo de compresión que promete revolucionar el panorama al reducir drásticamente el uso de memoria de los grandes modelos de lenguaje (LLMs) hasta seis veces, mientras mejora simultáneamente la velocidad de procesamiento sin comprometer la calidad de los resultados.

El objetivo principal de TurboQuant es optimizar el tamaño de la caché de clave-valor, que Google describe como una "hoja de trucos digital" donde se almacena información importante para evitar cálculos repetitivos. Esta caché es esencial porque los LLMs no poseen conocimiento real, sino que simulan comprensión mediante vectores que mapean el significado semántico del texto tokenizado. Los vectores de alta dimensión, con cientos o miles de incrustaciones, ocupan enormes cantidades de memoria y crean cuellos de botella en el rendimiento del sistema.

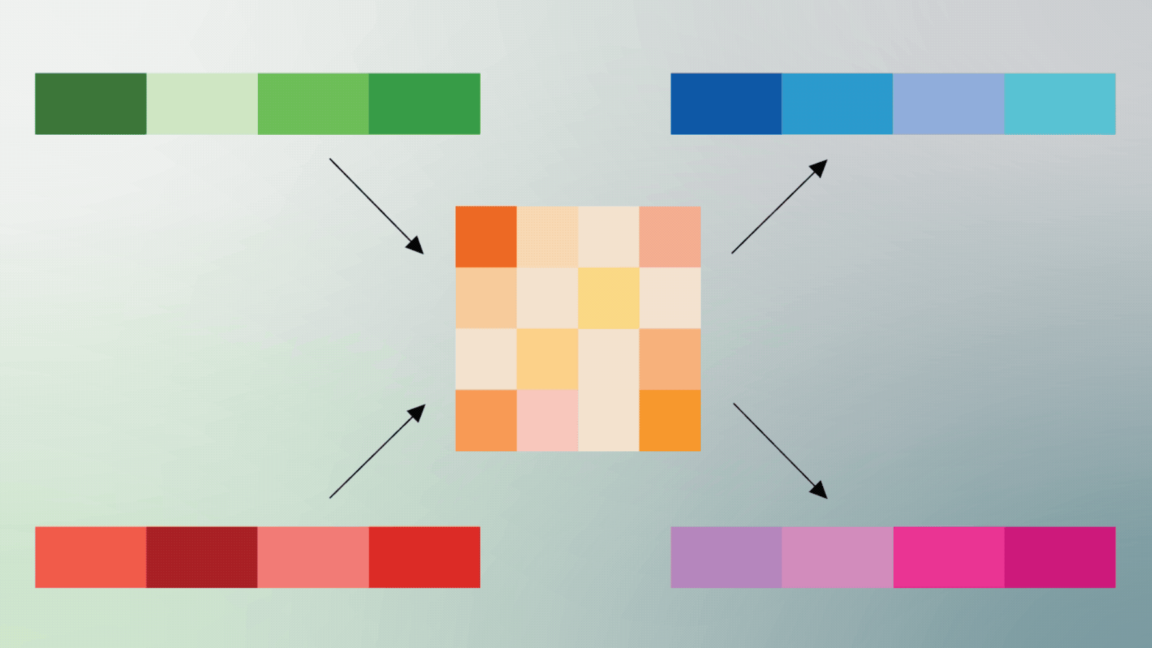

La solución de Google se implementa en dos pasos complementarios. Primero, utiliza PolarQuant, un sistema que convierte los vectores de coordenadas cartesianas estándar a coordenadas polares. En esta cuadrícula circular, los vectores se reducen a dos datos esenciales: un radio que representa la fuerza central de los datos, y una dirección que indica su significado. Google lo compara con cambiar direcciones de "camina 3 cuadras al Este, 4 al Norte" a simplemente "camina 5 cuadras a 37 grados", ocupando menos espacio y eliminando costosos pasos de normalización de datos.

El segundo paso aplica la técnica Quantized Johnson-Lindenstrauss (QJL), que funciona como una capa de corrección de errores de 1 bit. Aunque PolarQuant logra una compresión efectiva, puede generar errores residuales. QJL suaviza estas imperfecciones reduciendo cada vector a un solo bit (+1 o -1) mientras preserva los datos esenciales que describen las relaciones vectoriales, resultando en puntuaciones de atención más precisas, el proceso fundamental mediante el cual las redes neuronales determinan qué datos son importantes.

Las pruebas realizadas por Google con los modelos abiertos Gemma y Mistral en diversos benchmarks de contexto largo mostraron resultados perfectos en todas las evaluaciones. TurboQuant logró reducir el uso de memoria en la caché de clave-valor hasta 6 veces, cuantizando la caché a solo 3 bits sin entrenamiento adicional, lo que significa que puede aplicarse a modelos existentes. Además, calcular la puntuación de atención con TurboQuant de 4 bits es 8 veces más rápido comparado con claves no cuantizadas de 32 bits en aceleradores Nvidia H100.

La implementación de TurboQuant podría hacer que los modelos de IA sean menos costosos de operar y requieran menos memoria. Sin embargo, las empresas también podrían aprovechar la memoria liberada para ejecutar modelos más complejos. La IA móvil podría ser la mayor beneficiaria, ya que las limitaciones de hardware de los smartphones hacen que técnicas de compresión como TurboQuant puedan mejorar significativamente la calidad de los resultados sin necesidad de enviar datos a la nube, manteniendo la privacidad del usuario.

Fuente Original: https://arstechnica.com/ai/2026/03/google-says-new-turboquant-compression-can-lower-ai-memory-usage-without-sacrificing-quality/

Artículo generado mediante LaRebelionBOT

No hay comentarios:

Publicar un comentario