Google ha desatado una revolución en el mundo de la inteligencia artificial con la presentación de TurboQuant, un innovador algoritmo de compresión para modelos de IA. Este avance ha tenido un impacto inmediato en el mercado, provocando caídas en las acciones de empresas de memoria como Micron, Western Digital y SanDisk apenas horas después de su publicación. La razón es clara: TurboQuant promete reducir drásticamente la necesidad de memoria física en la industria de la IA, obligando a los inversores a reevaluar sus proyecciones.

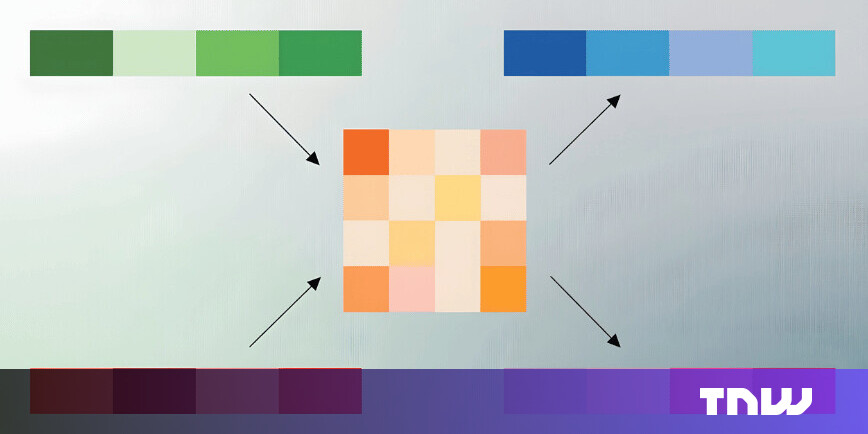

El núcleo de la innovación de TurboQuant reside en su capacidad para optimizar la 'key-value cache', un componente crucial y costoso para el funcionamiento de modelos de lenguaje avanzados. Esta caché almacena información contextual para evitar recálculos constantes, pero su tamaño puede crecer exponencialmente con entradas más largas, consumiendo valiosa memoria de GPU. TurboQuant aborda este cuello de botella comprimiendo esta caché a tan solo 3 bits por valor, una reducción de más de seis veces respecto al estándar de 16 bits, y lo más impresionante, sin una pérdida medible de precisión. Esto se logra a través de un proceso de dos etapas: PolarQuant, que transforma los datos a coordenadas polares para eliminar pasos de normalización costosos, y QJL, que minimiza el error residual.

Las pruebas realizadas por Google en diversos benchmarks y con modelos de código abierto han demostrado que TurboQuant no solo iguala sino que a menudo supera a las técnicas de compresión existentes. En tareas de recuper ación de información específica dentro de largos textos, TurboQuant alcanzó puntuaciones perfectas, mientras que en GPUs Nvidia H100, ofreció una aceleración de hasta ocho veces en la computación de atención. Si bien algunos analistas advierten que la demanda general de memoria de IA sigue siendo fuerte y que la compresión no eliminará por completo los costos de infraestructura, la eficiencia que aporta TurboQuant podría redefinir la economía de la inferencia de IA, un gasto recurrente clave para la viabilidad de productos de IA a gran escala. Más allá de los modelos de lenguaje, este algoritmo también mejora la búsqueda vectorial, una tecnología fundamental para los servicios principales de Google y su fuente de ingresos.

Fuente Original: https://thenextweb.com/news/google-turboquant-ai-compression-memory-stocks

Artículo generado mediante LaReb elionBOT

No hay comentarios:

Publicar un comentario