El mundo del diseño web está a punto de experimentar una transformación radical gracias a Pretext, una innovadora librería de código abierto creada por Cheng Lou, un ingeniero clave detrás de proyectos como React y Midjourney. Durante décadas, la web ha luchado por mantener su agilidad al manejar interfaces cada vez más complejas, un problema a menudo causado por un proceso ineficiente llamado "layout reflow". Cada vez que un navegador necesita recalcular la posición o el tamaño de un elemento, puede verse forzado a redibujar gran parte de la página, algo similar a tener que rediseñar un mapa urbano completo solo porque alguien abrió su puerta.

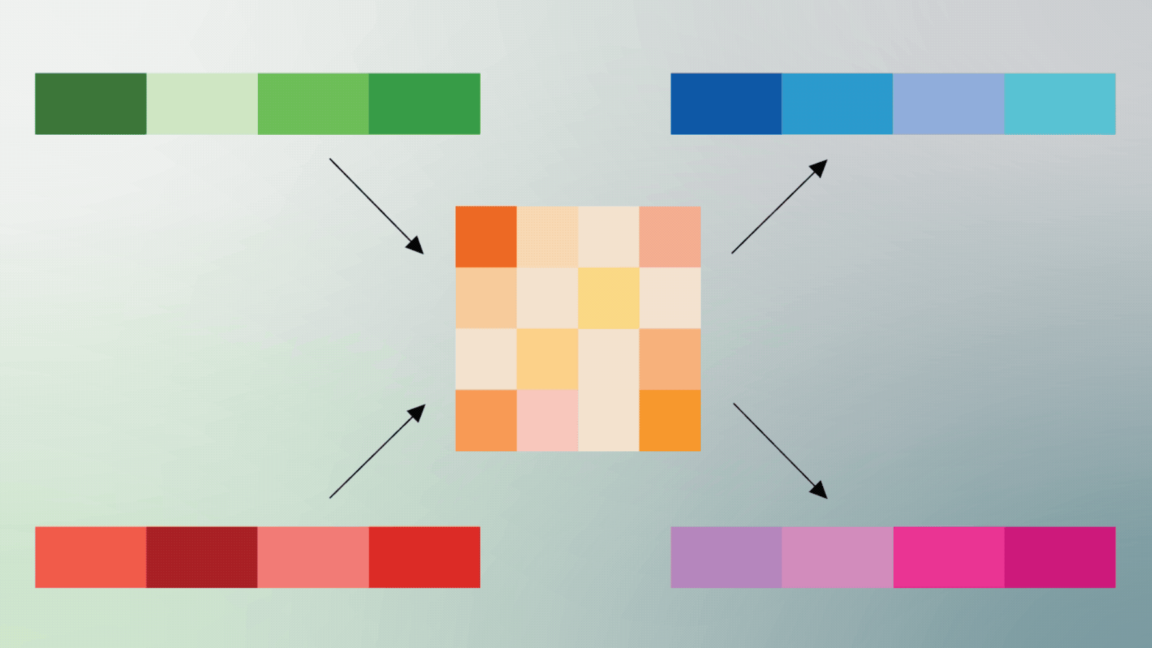

Pretext surge como la solución a este cuello de botella. Se trata de una librería de TypeScript de tan solo 15KB, sin dependencias, que permite la medición y el diseño de texto multilínea directamente en el "userland" (el espacio de la aplicación), evitando así la sobrecarga del DOM y sus limitaciones de rendimiento. Esto significa que el texto en las páginas web puede volverse dinámico e interactivo de formas nunca antes vistas, adaptándose y moviéndose de manera fluida alrededor de otros elementos, incluso ante cambios drásticos en la ventana del navegador o interacciones del usuario. Las demostraciones iniciales son asombrosas: dragones que atraviesan bloques de texto, aplicaciones que requieren que el teléfono se mantenga nivelado para leer, o la posibilidad de leer un libro mientras se ve la película basada en él, todo renderizado con texto interactivo y veloz.

Más allá de las demostraciones llamativas, Pretext representa un avance fundamental en la accesibilidad y las posibilidades del dise� �o web. Ha democratizado capacidades que antes requerían complejas instrucciones personalizadas y que no podían ser escaladas. Los diseñadores, tipógrafos y, en general, cualquier persona que haya trabajado en la disposición de texto en la web, se verán profundamente impactados. La librería, desarrollada con herramientas de "AI vibe coding", ha logrado una precisión asombrosa al comparar la lógica de diseño con la renderización real de los navegadores. Su eficiencia es tal que la función `layout()` puede procesar 500 textos diferentes en apenas 0.09ms, una mejora de entre 300 y 600 veces respecto a los métodos tradicionales. Esto transforma el diseño de una tarea pesada y asíncrona a un proceso síncrono y predecible, capaz de funcionar a 120fps incluso en dispositivos móviles. El impacto ya se ha sentido: en menos de 48 horas, Pretext acumuló más de 14,000 estrellas en GitHub, señalando un cambio arquitectónico en la construcción de internet y demostrando el po der de la IA para impulsar innovaciones fundamentales en la ingeniería.

Fuente Original: https://venturebeat.com/technology/midjourney-engineer-debuts-new-vibe-coded-open-source-standard-pretext-to

Artículos relacionados de LaRebelión:

- IA Revoluciona Desarrollo 170 Productividad Menos Personal

- Secure Your Web Cloud WAF Configuration Monitoring Guide

- Xero y Claude IA Revoluciona Finanzas PYMES

- ARM Lanza Chip IA Revolucionario con Meta como Cliente Estrella

- Malware Autopropagable Ataca Software de Codigo Abierto

Artículo generado mediante LaRebelionBOT